道高一丈!反人脸识别技术取得重大突破

人脸识别技术在广泛应用的同时,也引发了公众对隐私信息泄露的担忧。好消息是,最近“反‘人脸识别技术’技术”的研究前沿出现了突破性进展。

“看山不是山”

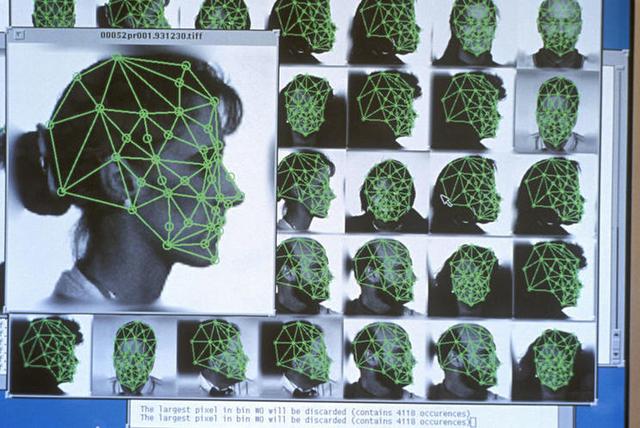

首先是来自挪威科技大学的《DeepPrivacy:A Generative Adversarial Network for Face Anonymization》用新的更有挑战表示的方法欺骗了人脸识别系统:在不改变原来的数据分布的前提下把人脸匿名化,更通俗的说法来说就是输出一张人脸识别系统无法正确识别的人脸,但是几乎不更改原图中人脸的姿态和样貌。

根据作者们的测试,经过他们技术处理的人脸仍然保持了接近于原图的人脸可识别性。一般而言,人脸识别对于匿名化后的图像,识别出人脸的平均准确率只下降了 0.7% 。而人脸含有的自然信息却是 100% 不重合的。

这种技术目前主要是应用在静态的图片上,做到“看山不是山”的效果。而对于动态场景,还需要挖掘该技术的更多潜能。

“看水不是水”

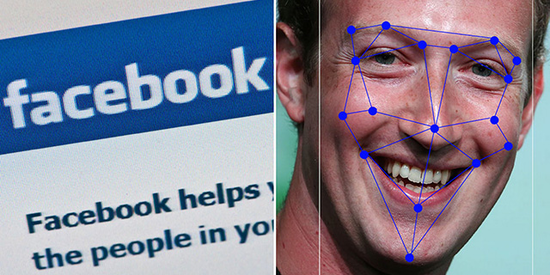

在动态场景的反人脸识别上,Facebook走的更远一些。

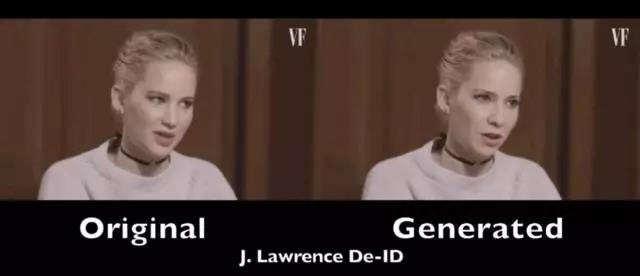

Facebook AI Research(FAIR)研发了一种“去识别(de-identification)”系统,该系统通可以通过机器学习实时更改视频中人脸的面部特征,用来欺骗面部识别系统,让其不能精准识别人脸数据。比方说,让面部识别系统将你识别为一位女明星。

相比于应用于静止图像的技术,FAIR推出的系统可以直接应用在实时的视频中,可以说是做到了“看水不是水”。

Facebook AI研究工程师和特拉维夫大学教授Lior Wolf表示,他们将对抗性自动编码器与分类器网络配对,让视频中的人脸稍微扭曲,在迷惑人脸识别系统的同时,又能让人们认出这个人的样貌。

此前由于被爆出涉嫌滥用用户的面部识别数据,Facebook被伊利诺伊州市民告上法庭。面临近350亿美元的集体诉讼,Facebook也需要用技术显示他们保护用户面部信息的决心。

Facebook的研究人员表示,“人脸识别可能会让我们的隐私泄露,并且‘换脸’技术可能会被用于制作误导性视频识别。”Facebook研究这项技术也是为了去除视频中的隐私信息。

▼

人工智能技术的进步对人类的信息安全是一个巨大的挑战,但是也并非完全不可控。

一方面可以限制科技可以踏足的领域,例如克隆领域就受到非常严格的监管,另一方面也可以“用AI来打败AI”,通过对反制手段的不断升级来保证技术一旦被滥用,有充足的手段来加以限制。

反人脸识别技术日渐成熟的背后是人类与技术相互适应的过程,技术终究是要服务于人的,对可能存在风险的技术加以改造、限制,然后再加以利用,从钻木取火的时代便是如此。对于近几年科学技术的突飞猛进,或许我们真的是过分担心了。

© Copyright 2013 南京奥特赛人工智能技术研发有限公司 版权所有 备案号:苏ICP备19032300号-1  苏公网安备32011602010459 技术支持:科威鲸网络

苏公网安备32011602010459 技术支持:科威鲸网络